BLIP3-o多模态统一模型 | MiniMax-Speech零样本语音合成 | INTELLECT-2去中心化RL训练【AI周报】

BLIP3-o多模态统一模型 | MiniMax-Speech零样本语音合成 | INTELLECT-2去中心化RL训练【AI周报】

摘要

本周亮点:BLIP3-o统一理解与生成任务;MiniMax-Speech实现32语种零样本语音克隆;INTELLECT-2首次实现全球去中心化强化学习大模型训练;Step1X-3D发布高保真3D资产生成框架;CAST支持从单图重建结构化3D场景。

目录

- BLIP3-o:全开源统一多模态模型,融合理解与生成能力

- MiniMax-Speech:支持32语种的零样本语音克隆大模型

- Step1X-3D:高保真可控的3D资产生成模型,支持LoRA微调

- Marigold:轻量级扩散模型微调,实现多任务图像分析

- INTELLECT-2:全球去中心化强化学习训练的32B推理模型

- CAST:单张RGB图像驱动的组件对齐3D场景重建

BLIP3-o:全开源统一多模态模型,融合理解与生成能力

概要:BLIP3-o 是由Salesforce Research 和 马里兰大学 等机构联合提出的全开源统一多模态模型系列,融合了自回归与扩散架构,采用“先理解后生成”的策略,创新性地结合 CLIP 特征与 Flow Matching 训练方法,显著提升了图像生成质量与多模态理解能力。该模型支持图像理解与生成任务,并提供完整的训练数据集与代码,促进多模态研究的开放性与可复现性。

标签:#多模态模型 #图像生成 #开源 #CLIP #FlowMatching

MiniMax-Speech:支持32语种的零样本语音克隆大模型

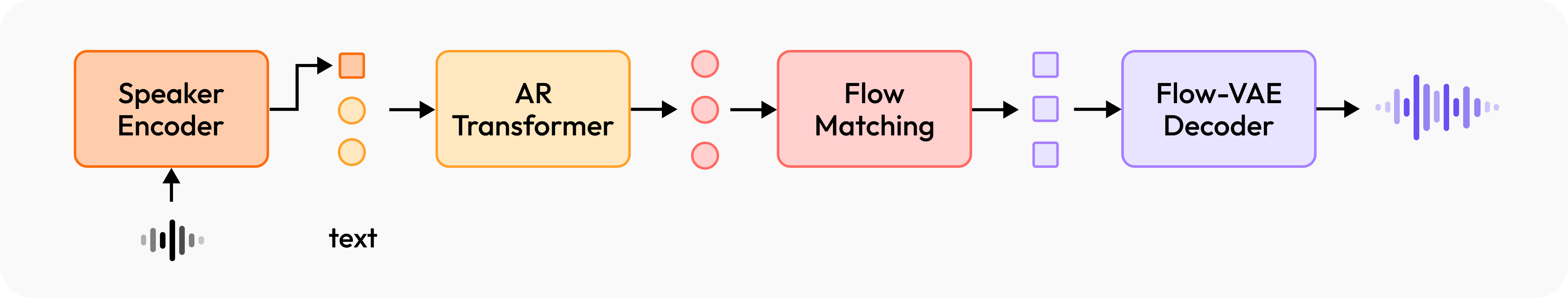

概要:MiniMax-Speech 是由 MiniMax 发布的新一代语音合成大模型,具备强大的零样本语音克隆能力。该模型基于自回归 Transformer 架构,融合可学习的音色编码器(Learnable Speaker Encoder),能够从参考音频中提取音色特征,实现高保真、情感丰富的语音合成。支持32种语言和多种情绪风格,适用于内容创作、虚拟人、教育等多种场景。在多个国际权威评测中,MiniMax-Speech 在字错误率(WER)和说话人相似度等指标上取得领先,展现出卓越的语音合成质量和广泛的应用潜力。

标签:#语音合成 #零样本克隆 #多语种支持 #个性化语音 #高保真音频

Step1X-3D:高保真可控的3D资产生成模型,支持LoRA微调

概要:Step1X-3D 是由 阶跃星辰 发布的开源3D生成模型,拥有4.8B参数(几何模块1.3B,纹理模块3.5B),采用原生两阶段架构,解耦几何与纹理表征。该模型通过混合VAE-DiT几何生成器与基于扩散的纹理合成模块,确保生成的3D模型结构完整、纹理细节丰富。Step1X-3D支持从文本提示或单张图像生成高质量的3D模型,并兼容LoRA等2D控制技术,提升生成的可控性与易用性。模型已开源训练代码和800K高质量3D资产,助力3D内容创作。

标签:#3D生成 #高保真建模 #纹理合成 #可控性 #LoRA微调

Marigold:轻量级扩散模型微调,实现多任务图像分析

概要:Marigold 是 苏黎世联邦理工学院 推出的扩散模型适配框架,旨在将预训练的 Stable Diffusion 模型转化为高效的图像分析工具,支持单目深度估计、表面法线预测和图像内在属性分解等任务。该方法通过最小化架构修改,结合小规模合成数据,在单张 GPU 上数日内完成训练,具备出色的零样本泛化能力。Marigold 还支持快速推理(<100ms)和高分辨率处理,适用于资源受限场景。

标签:#扩散模型 #图像分析 #深度估计 #表面法线 #内在属性分解 #轻量级微调

INTELLECT-2:全球去中心化强化学习训练的32B推理模型

概要:INTELLECT-2 是由 Prime Intellect 团队 发布的 320 亿参数语言模型,首次通过全球去中心化的强化学习(RL)方式进行训练。该模型采用异步分布式 RL 框架 PRIME-RL,结合高效权重广播系统 SHARDCAST 和验证机制 TOPLOC,确保训练稳定性与数据可靠性。实验结果表明,INTELLECT-2 在数学和编程任务上超越同类模型 QwQ-32B,验证了去中心化 RL 训练的有效性和潜力。

标签:#去中心化训练 #强化学习 #大语言模型 #异步训练 #开源模型

CAST:单张RGB图像驱动的组件对齐3D场景重建

概要:CAST(Component-Aligned 3D Scene Reconstruction from a Single RGB Image)是由 上海科技大学 提出的一种创新的3D场景重建方法,能够从单张RGB图像中生成结构合理、物理一致的3D场景。该方法首先提取图像中的对象级2D分割和相对深度信息,利用GPT模型分析对象间的空间关系,确保重建结果的连贯性。随后,CAST使用考虑遮挡的3D生成模型独立生成每个对象的完整几何形状,并通过对齐生成模块计算必要的变换,将生成的网格精确地放置到场景的点云中。最后,CAST引入物理一致性校正步骤,利用精细的关系图优化对象姿态,确保生成场景在物理交互上的准确性。该方法在虚拟内容创作、机器人仿真等领域具有广泛的应用前景。

标签:#3D重建 #单图像输入 #GPT空间关系建模 #物理一致性 #虚拟仿真