Intern-S1发布多模态基础模型 | Meta推出DINOv3 | 微软开源POML【AI周报】

Intern-S1发布多模态基础模型 | Meta推出DINOv3 | 微软开源POML【AI周报】

摘要

本周亮点:InternLM 推出多模态大模型 Intern‑S1,提升感知、理解与生成;Meta 发布 DINOv3 推进自监督视觉;微软开源 POML;MobileAgent、Ovis、Thyme 等亦亮相,覆盖智能体与多模态应用。

目录

- Intern‑S1:科学领域强化的多模态基础模型

- MobileAgent:面向移动设备的通用多模态智能体

- DINOv3:自监督视觉表征学习新范式

- Ovis:统一多模态视频生成与理解模型

- Thyme:跨模态时间感知视觉语言模型

- Matrix-Game 2:大规模多智能体博弈环境

- POML:跨模态程序化语言

- ColorCtrl:可控图像颜色编辑

Intern‑S1:科学领域强化的多模态基础模型

概要:Intern‑S1 由 上海人工智能实验室(InternLM) 团队发布,定位为“面向科学”的多模态基础模型。论文披露其为 Mixture‑of‑Experts(MoE) 架构:总参数约 241B、激活参数 28B,在 5T token 上持续预训练(其中 2.5T 为科学域数据),并在 InternBootCamp 框架下进行离线+在线强化学习,提出 Mixture‑of‑Rewards(MoR) 同时对千余任务优化。官方评测显示,Intern‑S1 在通用推理保持开源一线水准,在专业科学任务(分子合成规划、反应条件预测、晶体热力学稳定性等)上显著超越开源模型,并在若干项目上逼近/超越闭源强 baseline。已提供多种推理与部署形态(如 GGUF、vLLM 支持)。

标签:#多模态推理 #MoE架构 #科学计算 #强化学习对齐 #大规模预训练

MobileAgent:面向移动设备的通用多模态智能体

概要:MobileAgent 由 清华大学与北京智源研究院 团队提出,是首个专注于 移动设备真实交互 的多模态智能体框架。该系统通过结合视觉、语音与文本输入,能够直接在智能手机上执行复杂操作,如应用控制、任务自动化与跨模态信息检索。论文中提出了 真实设备操作轨迹收集与模拟环境结合 的训练策略,大幅提升了在真实手机上的泛化能力。实验显示,MobileAgent 在跨应用多任务执行的成功率显著超越现有方法,为多模态大模型的 落地应用与人机交互 提供了可行路径。

概要:MobileAgent 由 清华大学与北京智源研究院 团队提出,是首个专注于 移动设备真实交互 的多模态智能体框架。该系统通过结合视觉、语音与文本输入,能够直接在智能手机上执行复杂操作,如应用控制、任务自动化与跨模态信息检索。论文中提出了 真实设备操作轨迹收集与模拟环境结合 的训练策略,大幅提升了在真实手机上的泛化能力。实验显示,MobileAgent 在跨应用多任务执行的成功率显著超越现有方法,为多模态大模型的 落地应用与人机交互 提供了可行路径。

标签:#多模态智能体 #移动设备 #人机交互 #任务自动化 #真实环境

DINOv3:自监督视觉表征学习新范式

概要:DINOv3 由 Meta AI Research 提出,是继 DINO 与 DINOv2 之后的最新一代自监督视觉模型。该版本在训练中引入 更高效的对比学习策略与掩码建模结合机制,在无需人工标注的情况下,学得更具泛化性的图像特征。DINOv3 在 ImageNet 分类、目标检测、语义分割 等多项任务中刷新自监督方法的性能基线,并在下游小样本学习与跨域迁移中展现出显著优势。研究进一步强调了大规模自监督学习在计算机视觉中的核心地位,为构建更强的 通用视觉基础模型 提供了新方向。

标签:#自监督学习 #视觉表征 #对比学习 #掩码建模 #计算机视觉

Ovis:统一多模态视频生成与理解模型

概要:Ovis 由 AIDC-AI 团队 提出,旨在构建一个统一的 视频生成与理解 框架。模型基于 扩散架构与跨模态对齐机制,不仅能进行高质量的视频生成,还能处理视频字幕、问答与编辑等理解类任务。Ovis 引入 跨模态一致性约束,确保视觉与文本之间的精准对齐,并在多种公开视频生成与理解基准上取得领先成绩。该工作展示了 统一架构驱动多模态任务 的潜力,为未来的 视频多模态大模型 奠定了基础。

标签:#视频生成 #视频理解 #多模态模型 #扩散模型 #跨模态对齐

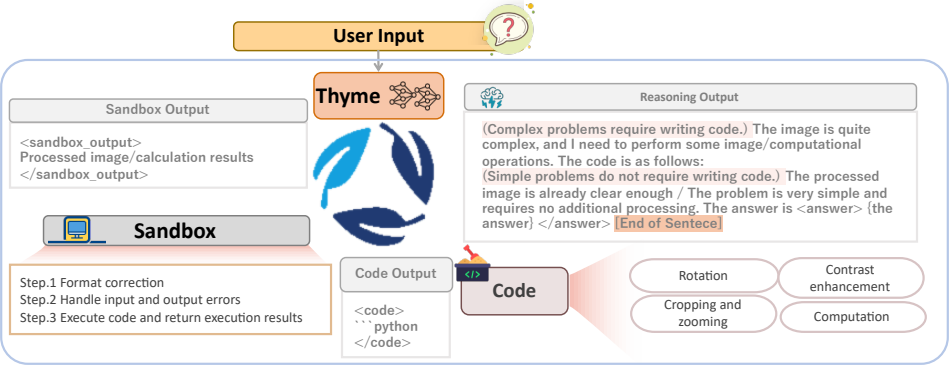

Thyme:跨模态时间感知视觉语言模型

概要:Thyme 由 复旦大学与上海人工智能实验室 提出,是首个显式建模 时间感知能力 的视觉语言模型(Vision-Language Model, VLM)。Thyme 在多模态 Transformer 中引入 时间编码与跨帧对齐机制,能够理解和推理跨帧动态信息,从而在视频问答、动作识别、事件理解等任务中表现优异。实验表明,Thyme 显著提升了 视频时序理解与跨模态推理 的性能,为构建具备 时序推理能力的多模态大模型 提供了新的解决方案。

标签:#视觉语言模型 #时序建模 #视频理解 #跨模态推理 #多模态学习

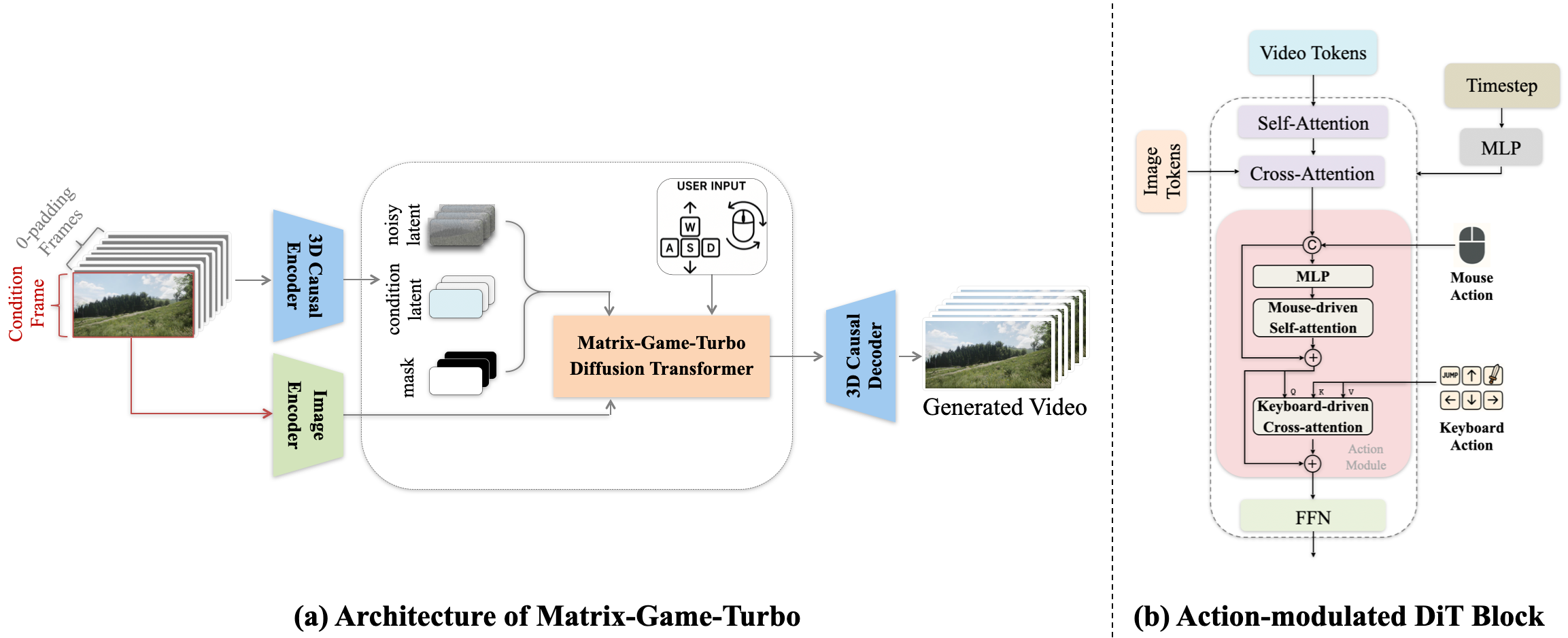

Matrix-Game 2:大规模多智能体博弈环境

概要:Matrix-Game 2 由 SkyworkAI 团队 提出,是一个专为 多智能体博弈与强化学习 研究设计的大规模基准环境。该框架基于 矩阵博弈与可扩展环境构建,支持数十万智能体的对抗、协作与混合策略训练。Matrix-Game 2 提供了丰富的对局场景与高效并行机制,能够系统性评估智能体在 策略演化、合作机制与博弈均衡 中的表现。该工作推动了 大规模多智能体系统研究,为通用人工智能中的 群体智能探索 提供了坚实平台。

标签:#多智能体 #博弈论 #强化学习 #群体智能 #AI基准

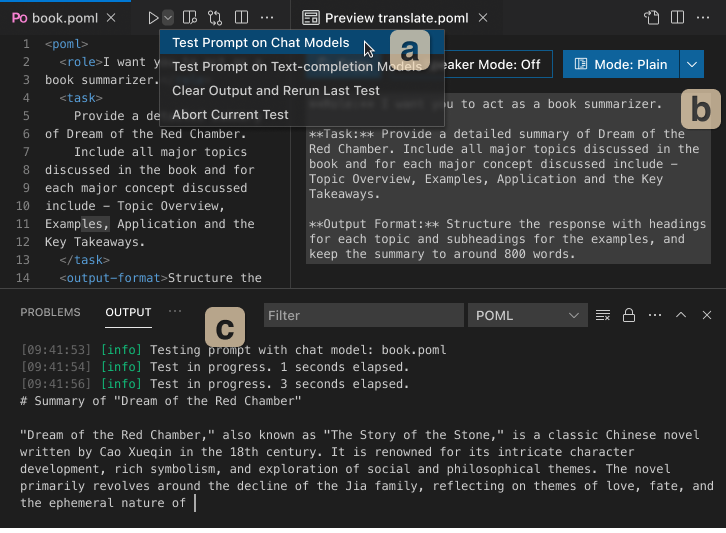

POML:跨模态程序化语言

概要:POML(Procedural Object Markup Language) 由 微软研究院 提出,是一种用于 跨模态场景建模与生成 的新型语言框架。POML 结合 程序化描述与多模态表示,可支持图像、视频、三维场景等内容的统一生成与编辑。通过与大模型结合,POML 能够高效完成 视觉生成、交互模拟与可控编辑,并在虚拟现实、游戏设计及多模态 AI 研究中展现出强大潜力。该工作为 结构化多模态生成 提供了通用接口,推动了 AI 在 内容创作与可控生成 方向的发展。

标签:#多模态 #程序化生成 #场景建模 #内容创作 #可控生成

ColorCtrl:可控图像颜色编辑

概要:ColorCtrl 由 香港中文大学与微软亚洲研究院 合作提出,旨在实现 高精度的可控图像颜色编辑。该方法结合 扩散模型与颜色感知控制机制,能够在不破坏原始结构与细节的前提下,对图像中的 局部或整体颜色 进行自然修改。ColorCtrl 支持多种交互方式,包括 文本驱动、调色板约束与区域指定,并在设计、艺术创作与图像修复等任务中表现出色。该研究为 可控图像生成与编辑 提供了新思路,提升了模型的灵活性与用户友好性。

标签:#图像编辑 #颜色控制 #扩散模型 #用户交互 #视觉生成