【ComfyUI 实战指南】FLUX.1 Kontext 入门教程:从零开始的图像编辑之旅

【ComfyUI 实战指南】FLUX.1 Kontext 入门教程:从零开始的图像编辑之旅

摘要

本教程介绍FLUX.1 Kontext的核心功能,包括局部编辑、角色一致性、风格参考和迭代编辑。通过ComfyUI实现环境搭建,提供硬件需求、模型下载及工作流配置指南。适用于设计创作、摄影后期及电商营销等场景,附提示词技巧和参数优化建议。

目录

基础认知

1.1 FLUX.1 Kontext 是什么

FLUX.1 Kontext 是 Black Forest Labs 开发的新一代图像编辑模型,专门用于基于上下文的图像修改和编辑。

核心优势:

- 局部精准编辑 - 只改想改的部分

- 上下文理解 - 理解图像中元素的关系

- 自然融合 - 编辑结果看起来很自然

- 语义控制 - 用自然语言描述想要的效果

1.2 Context 概念解析

Context(上下文) 就是模型能"看懂"整张图片的能力:

- 空间关系 - 知道前景背景、光影位置

- 语义理解 - 区分不同物体和概念

- 逻辑一致 - 保持场景的合理性

比如说,你输入一张蓝猫,可以让他跳舞、倒立、说唱,但是它始终保持背景和角色本身的一致性。

1.3 核心应用场景

主要用途:

- 设计创作 - 海报、UI、插画的快速调整

- 摄影后期 - 人像服装、风景天空、产品颜色

- 电商营销 - 同款商品不同颜色展示

- 内容创作 - 社交媒体、视频缩略图变体

环境搭建

FLUX.1 Kontext [dev] 有 ComfyUI 原生支持,因此环境比较简单。

2.1 硬件要求

| 模型版本 | GPU显存需求 | 推荐配置 | 备注 |

|---|---|---|---|

| Full Version | 32GB VRAM | RTX 6000 Ada/A6000 | 完整精度,质量最佳 |

| FP8 量化版本 | 16GB VRAM | RTX 4090/RTX 4080 | 推荐选择,性价比高 |

| GGUF (Q4_K_M) | 12GB VRAM | RTX 4070 Ti/RTX 3090 | 量化版本,入门首选 |

系统内存建议:至少 16GB RAM,推荐 32GB 以上

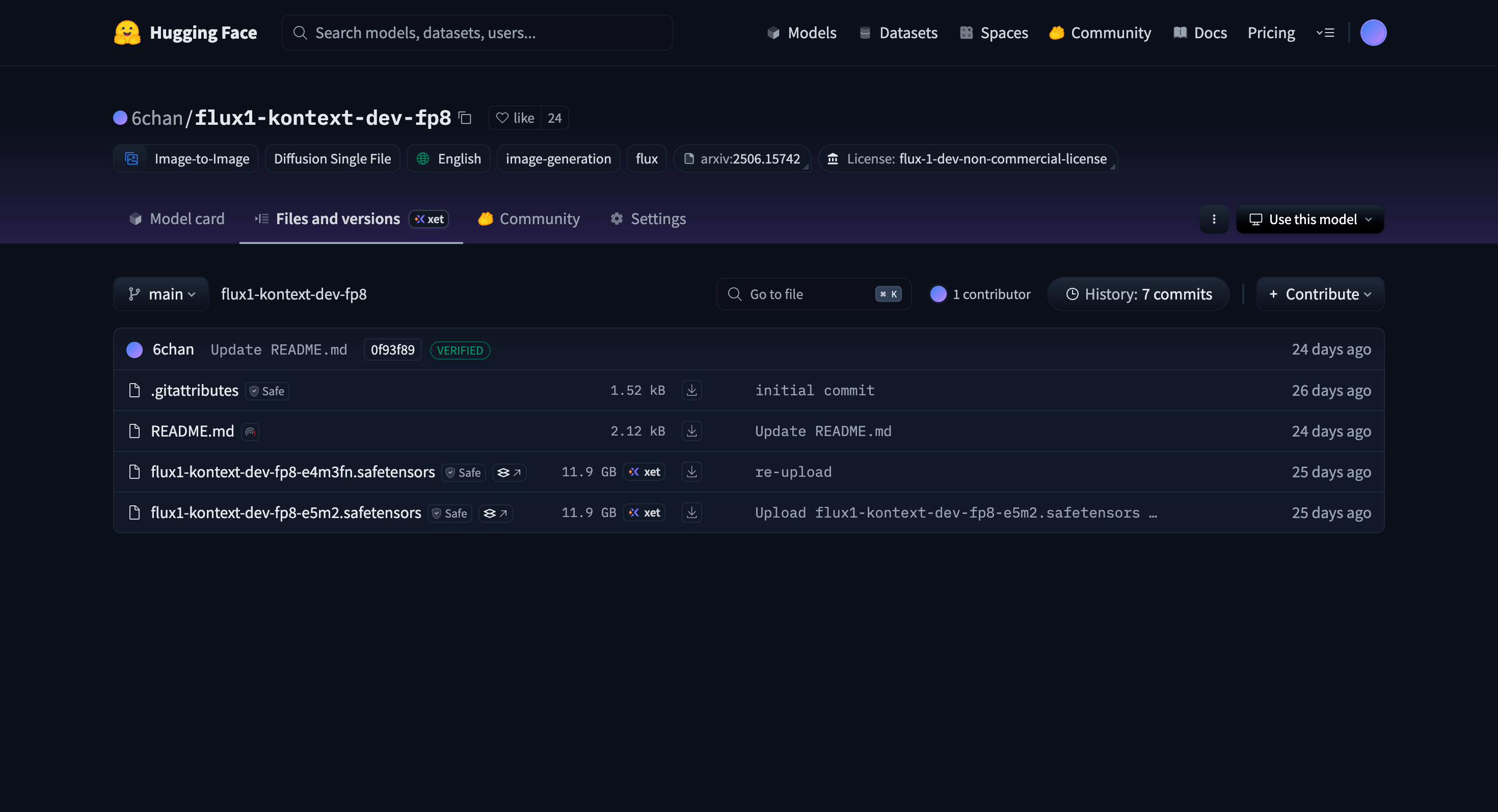

2.2 模型文件下载

FLUX Kontext 模型:

# 进入 diffusion_models 目录

cd ComfyUI/models/diffusion_models

# 下载 FLUX Kontext 模型

wget https://huggingface.co/Comfy-Org/flux1-kontext-dev_ComfyUI/resolve/main/split_files/diffusion_models/flux1-dev-kontext_fp8_scaled.safetensorsCLIP L 模型:

# 进入 clip 目录

cd ComfyUI/models/clip

# 下载 CLIP L 模型

wget https://huggingface.co/comfyanonymous/flux_text_encoders/blob/main/clip_l.safetensorsT5 模型:

# 进入 t5 目录

cd ComfyUI/models/t5

# 下载 T5 模型

wget https://huggingface.co/comfyanonymous/flux_text_encoders/resolve/main/t5xxl_fp16.safetensorsAE 模型:

# 进入 vae 目录

cd ComfyUI/models/vae

# 下载 AE 模型

wget https://huggingface.co/Comfy-Org/Lumina_Image_2.0_Repackaged/blob/main/split_files/vae/ae.safetensors2.3 工作流准备

工作流可以通过以下两种方式获取:

- 下载教程顶部的"Hello Kontext"图。

- 下载ComfyOrg的工作流图片:https://github.com/Comfy-Org/example_workflows/blob/main/flux/kontext/flux1_kontext.png?raw=true。

下载完成后,将工作流文件拖入 ComfyUI 界面,即可自动读取其元数据并加载工作流。

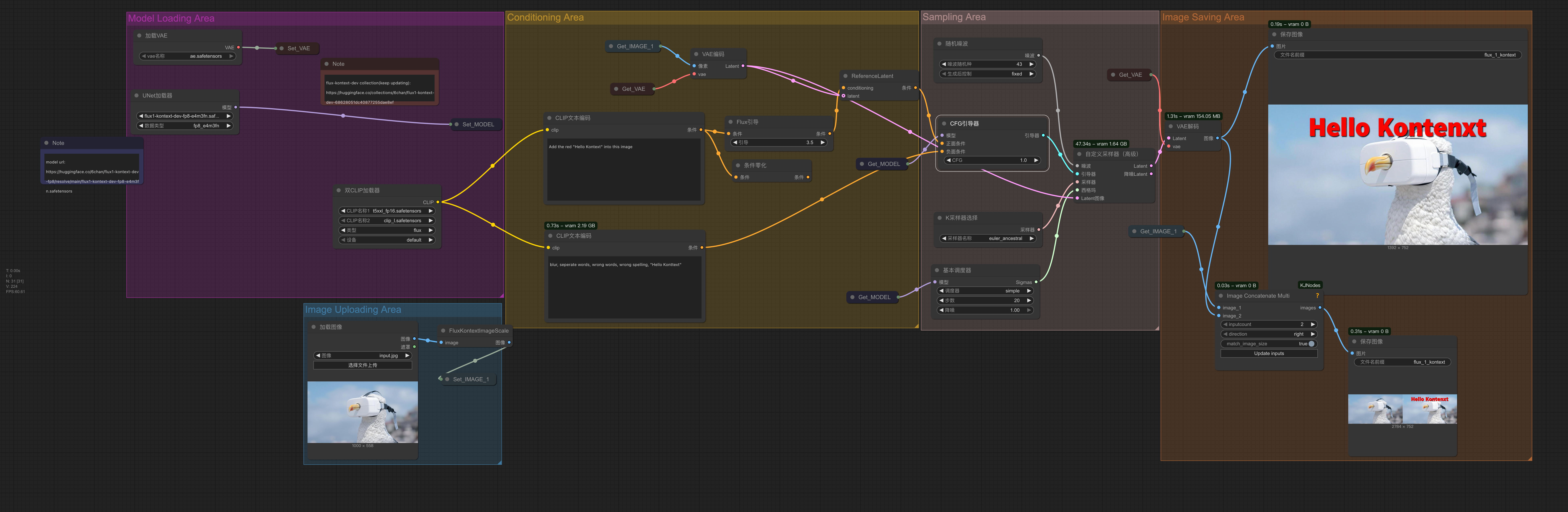

实战入门

3.1 Hello Kontext 初体验

第一个任务:加载工作流和基础设置

- 打开 ComfyUI,加载 Flux.1 Kontext Dev 工作流

- 确认模型文件已正确加载

- 准备一张测试图片

- 在 CLIP文本编码 框输入简单的编辑指令

- 点击 "Queue Prompt",观察生成过程

预期效果:成功生成编辑后的图像,验证环境配置正确。

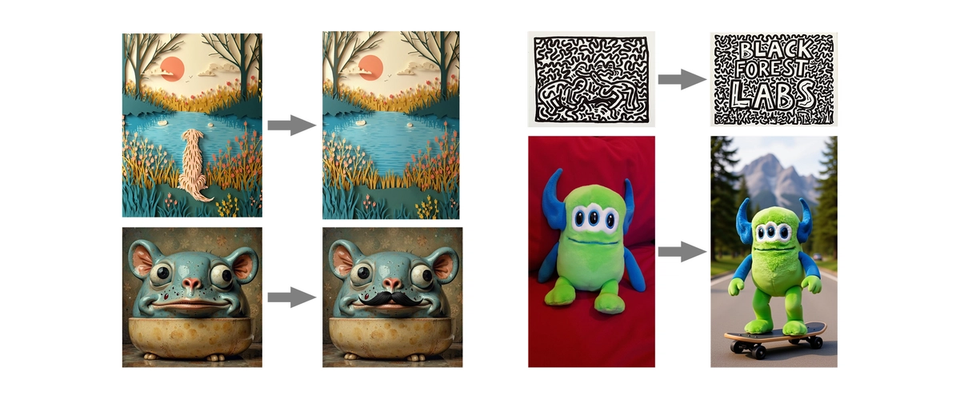

3.2 五大核心功能

1. 局部编辑 - 只改指定部分

| 原图 | 编辑后 |

|---|---|

|  |

| 黄色汽车原图 | 改为红色后,其他部分保持不变 |

Prompt:"Change the yellow car to red" 效果:只有车子颜色改变,背景、光影、其他元素完全保持不变

2. 角色一致性 - 同一角色不同场景

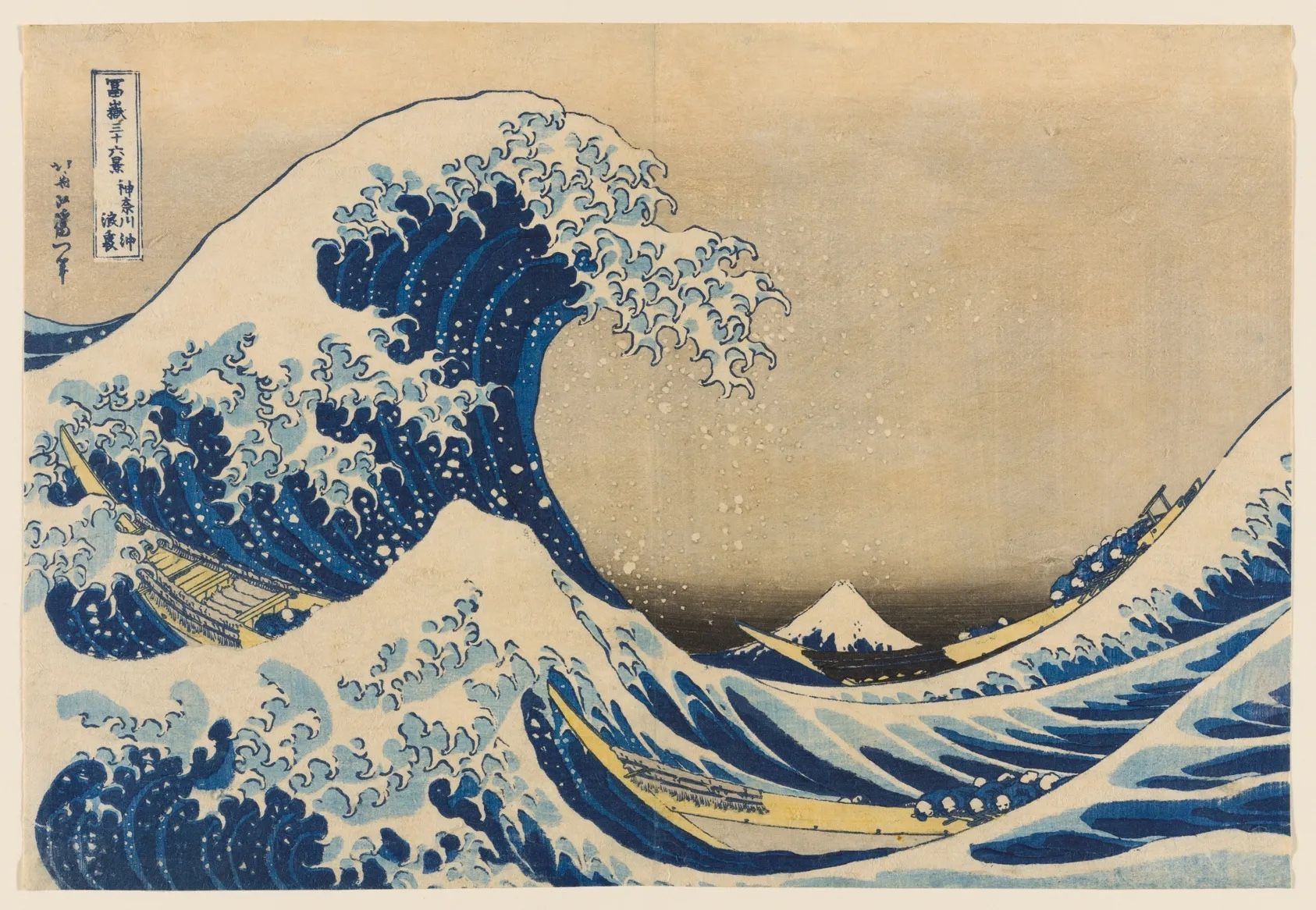

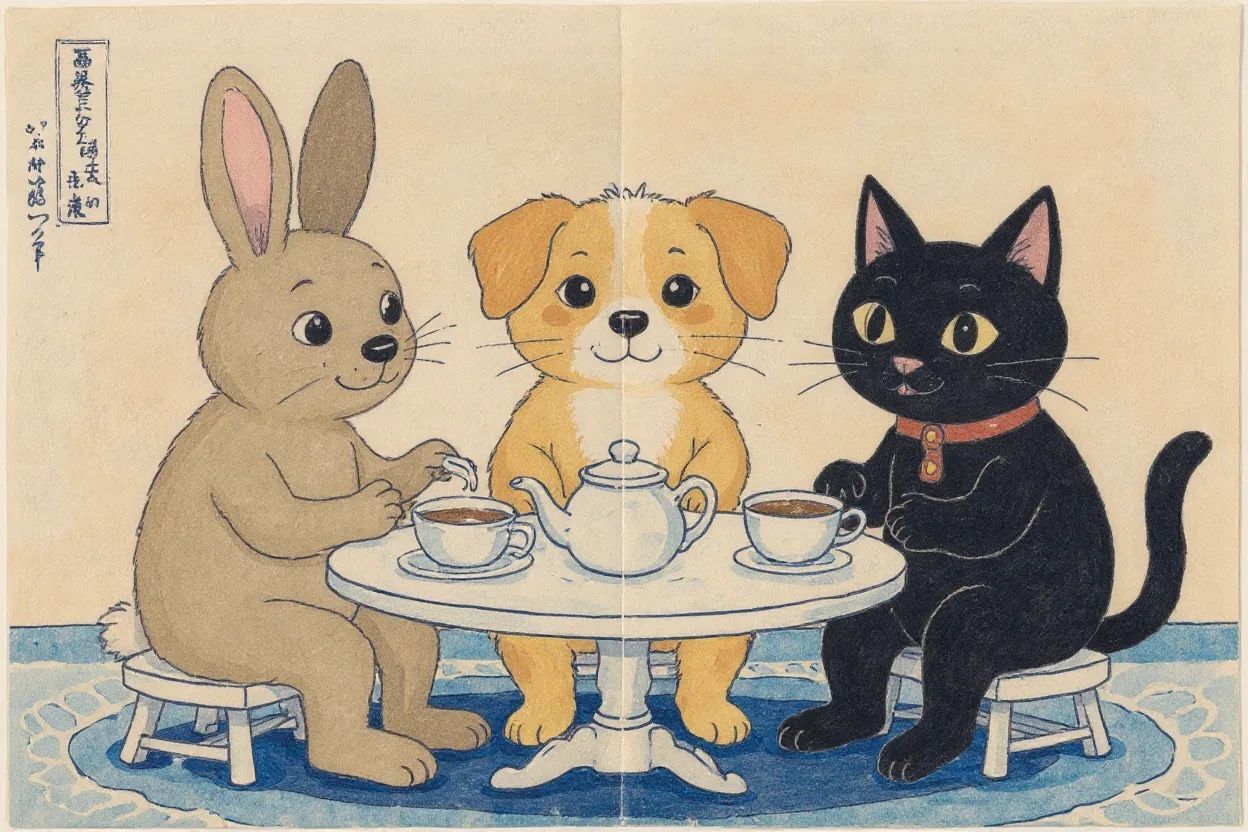

3. 风格参考 - 保持艺术风格

| 风格参考输入 | 应用结果 |

|---|---|

|  |

| 风格参考图像 | 应用风格参考后的结果 |

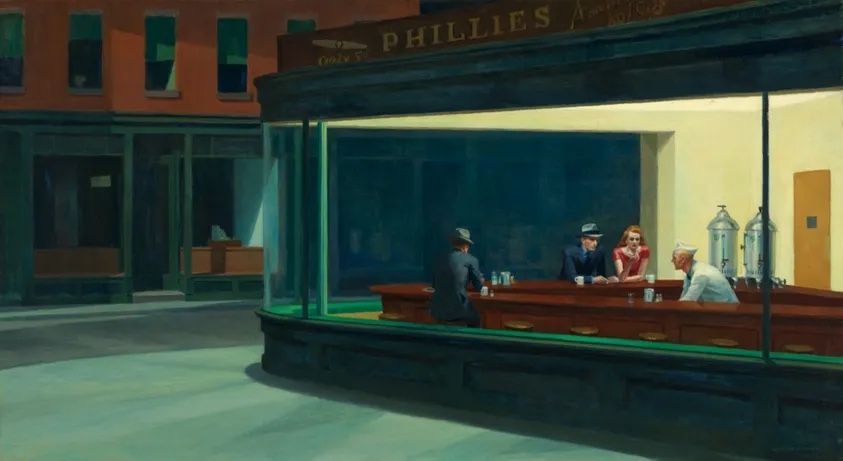

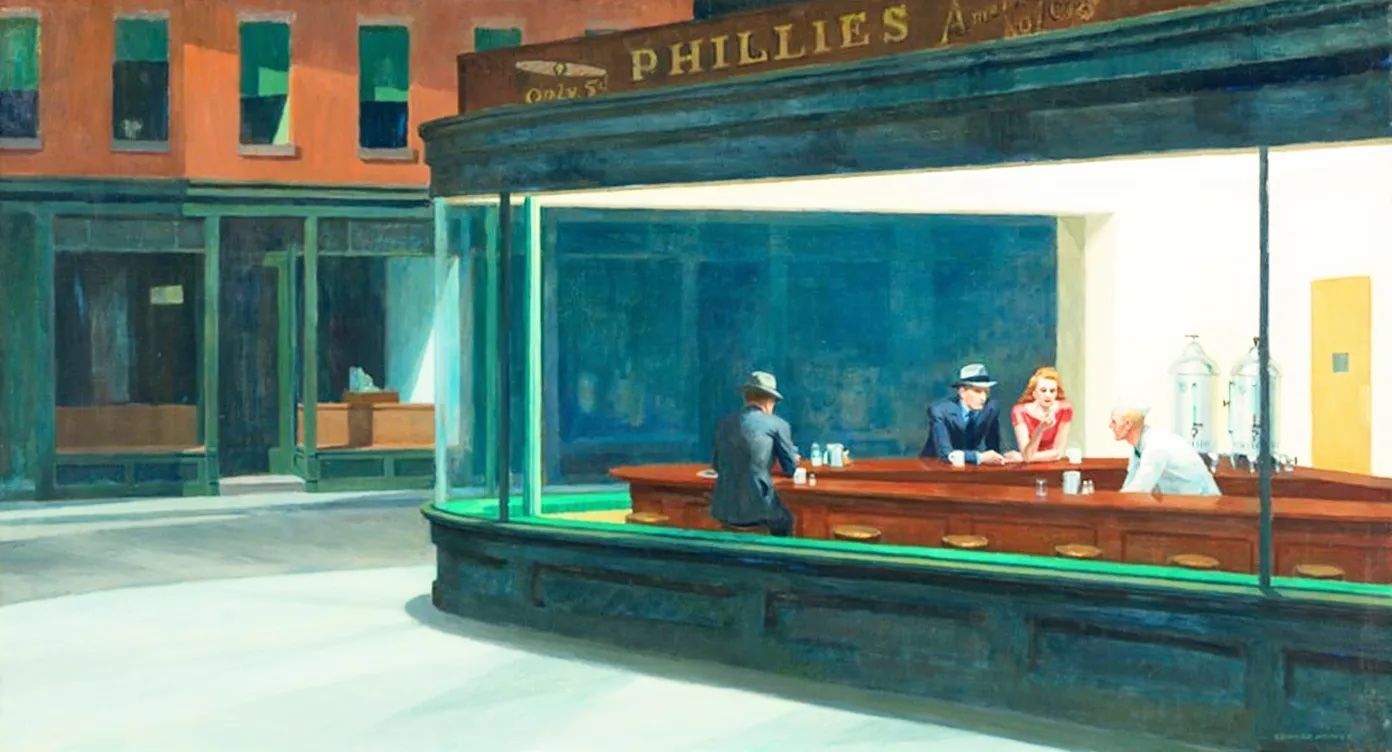

4. 迭代编辑 - 基于上次结果继续编辑

| 输入图像 | 编辑结果 |

|---|---|

|  |

| 原始夜晚街景绘画 | 转换为白天场景 |

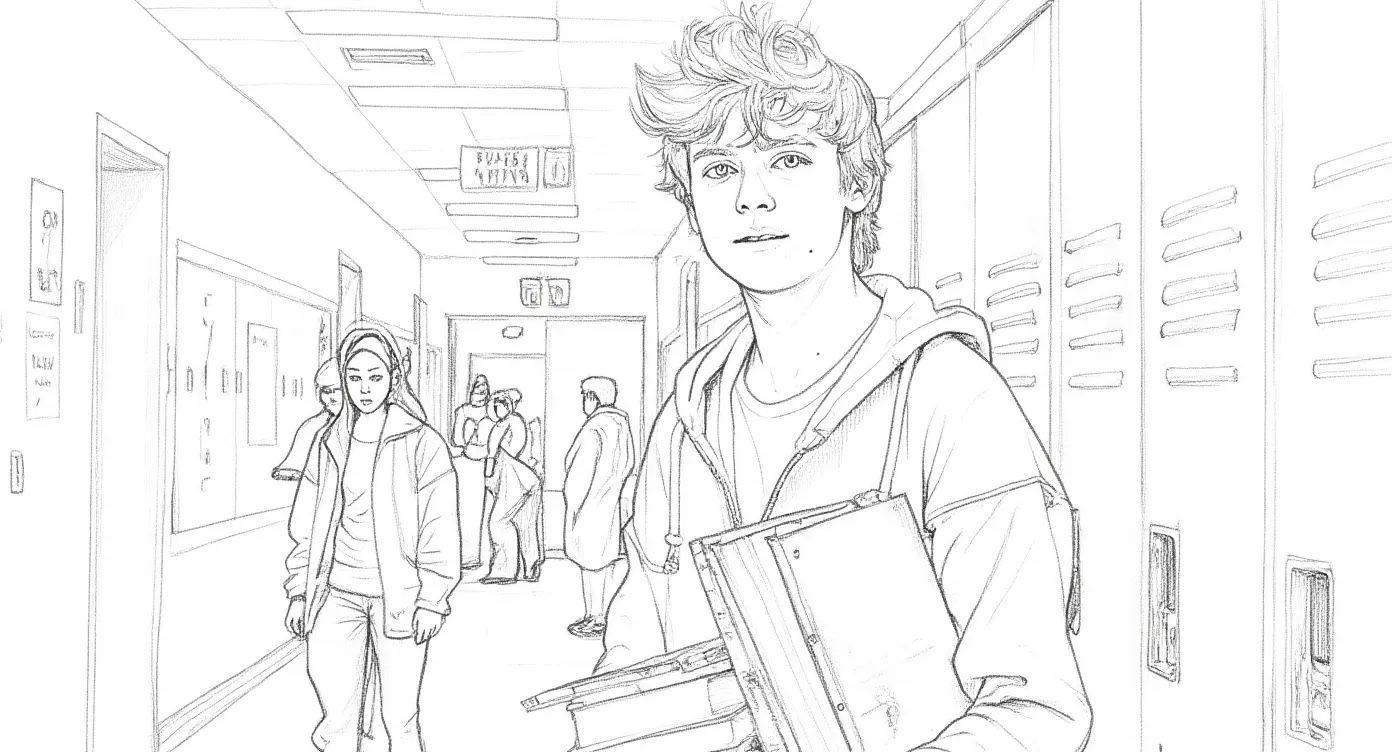

3.3 风格转换示例

| 原始图像 | 铅笔素描风格 | 油画风格 |

|---|---|---|

|  |  |

| 原始建筑物照片 | 转换为铅笔素描风格 | 转换为油画风格 |

风格转换 Prompt 示例:

- 铅笔素描:"Convert to pencil sketch style, black and white"

- 油画风格:"Transform to oil painting style, rich colors"

3.4 提示词技巧

基本原则:

- 简洁明了:"Change yellow car to red"

- 必要时详细:"Change to daytime, keep the painting style"

- 避免冗余:"Please change the automotive vehicle..."

常用动作词:

- 替换:change, replace, turn into

- 添加:add, include, put

- 移除:remove, delete

- 调整:make, adjust

质量控制:

- 保持一致:"keep the same style"

- 提升质量:"high quality", "detailed"

Token 限制说明: 根据官方资料,FLUX.1 使用双编码器架构:

- CLIP L/14 编码器:固定 77 tokens 限制

- T5-v1.1-XXL 编码器:最大支持 512 tokens

实际使用中建议保持提示词简洁明了。

进阶应用

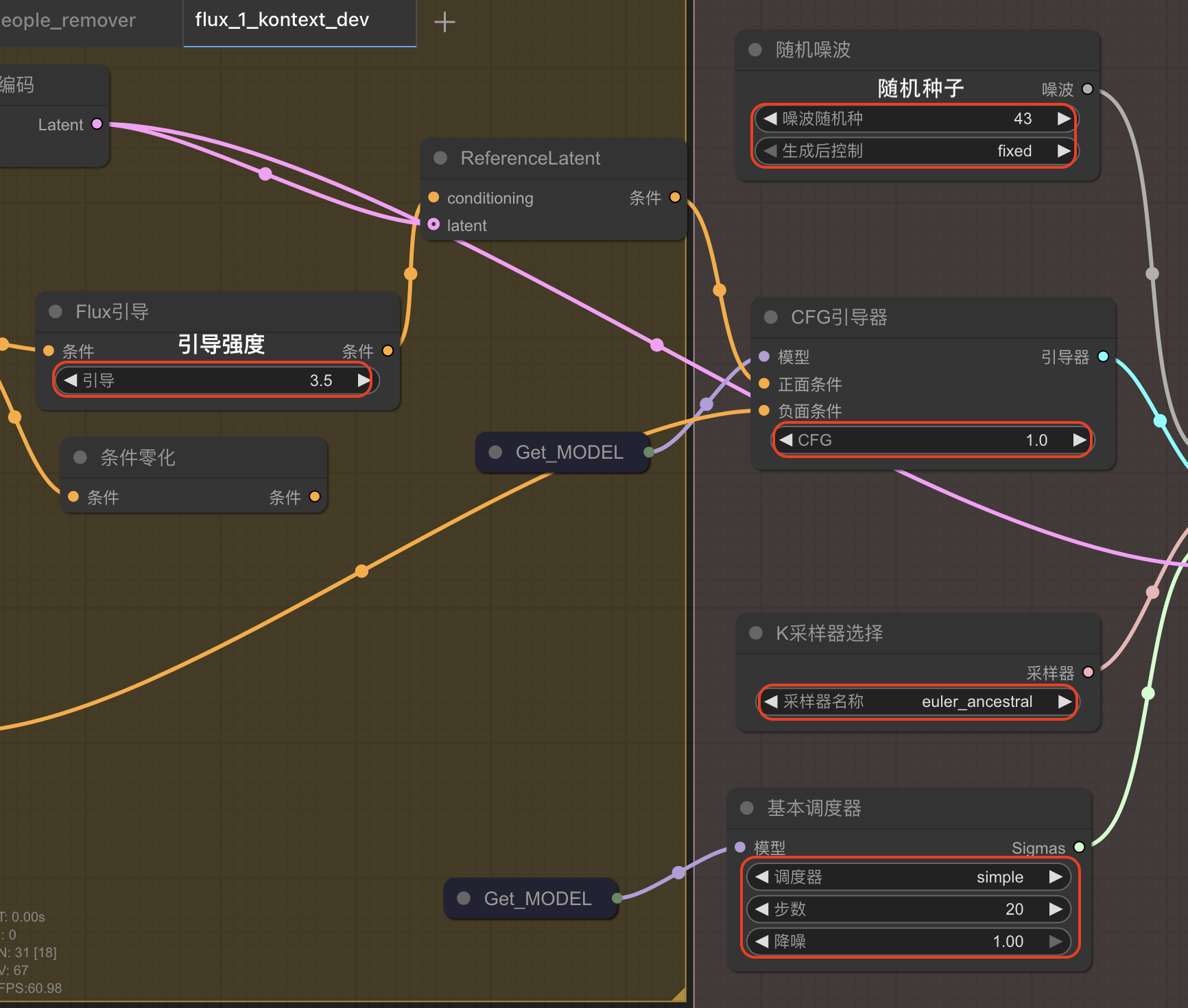

4.1 参数优化策略

重要说明:以下参数为基于社区经验的建议值,具体参数名称和范围请以实际工作流为准。

常见参数类型:

Denoise (去噪强度):控制编辑程度 一般无需调整,保持默认值1

CFG 一般无需调整,保持默认值1

FLUX Guidance(FLUX引导强度):提示词引导强度 推荐范围2.5-5,实测3.0、3.5效果很好。

Steps (采样步数):生成质量 推荐范围20-30,更多步数通常质量更好但速度更慢

参数调优建议:

- 先使用工作流默认参数测试

- 根据效果逐步微调单个参数

- 记录有效的参数组合

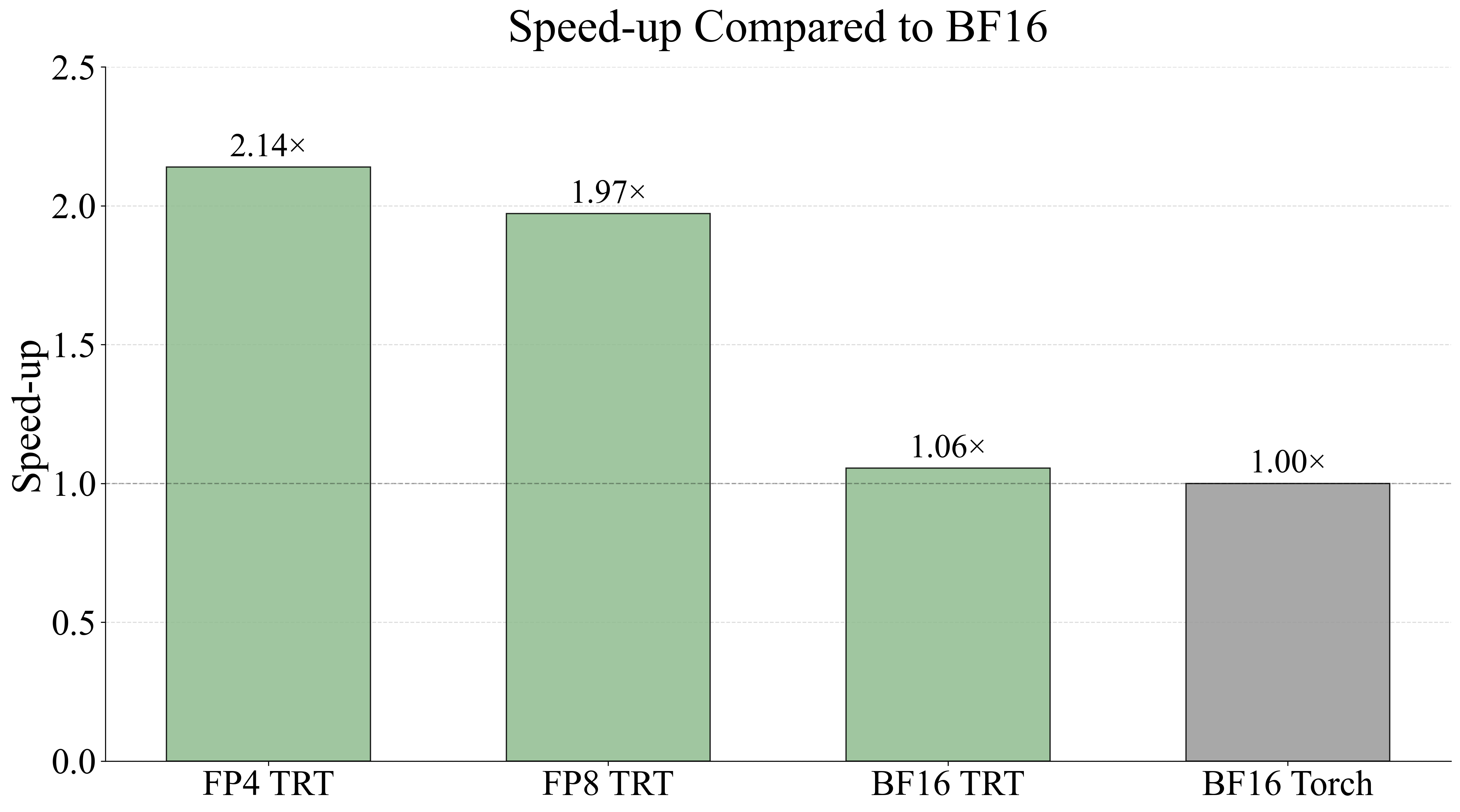

4.2 硬件加速展示

4.3 常见问题解决

| 问题类型 | 解决方法 |

|---|---|

| 图片质量下降 | 1. 检查去噪强度是否过高 2. 确认原图分辨率足够 3. 检查 VAE 加载是否正确 |

| 编辑指令不生效 | 1. 提示词更具体 2. 调整相关强度参数 3. 确保编辑对象清晰可见 |

| 显存不足 | 1. 降低图片分辨率 2. 使用量化版本模型 3. 关闭其他GPU程序 |

| 速度优化 | 1. 使用 GGUF 或 Nunchaku 量化版本 2. 使用 FLUX 的4步和8步 LoRA 3. 降低 Steps |

学习资源

基础教程学完了,接下来你可能想要更深入地探索。这里列出一些重要的学习资源。

5.1 社区平台推荐

官方资源:

- BFL官网:https://bfl.ai - 最新功能和技术更新

- ComfyUI GitHub:https://github.com/comfyanonymous/ComfyUI - 源码和问题讨论

专业平台:

- OpenArt.ai:工作流分享:https://openart.ai/workflows/profile/elephant_substantial_15?sort=latest

- Reddit r/comfyui:技术讨论和经验分享

5.2 进阶学习路径

阶段1:熟练基础操作

- 完成各种基础编辑任务

- 尝试不同的工作流模板

- 记录好用的参数组合

阶段2:掌握高级技巧

- 练习角色一致性编辑

- 学会自定义工作流

- 尝试批量处理任务

5.3 技术支持渠道

遇到问题时:

- 基础问题:评论区、微信群

- 技术问题:Reddit、GitHub Issues、Huggingface Community

- Bug报告:ComfyUI官方Issue页面